Redes Neuronales Biomoleculares

2025 Workshop en Modelamiento de Sistemas Biológicos

Las redes neuronales artificiales han revolucionado la computación moderna gracias a su capacidad de aprender patrones complejos y realizar tareas de clasificación o predicción. Sin embargo, más allá del silicio, recientes avances en biología sintética han comenzado a explorar cómo implementar redes neuronales dentro de sistemas moleculares para mejorar la capacidad computacional de células (Moorman et al, 2021). En esta lección estudiaremos cómo modelar y diseñar clasificadores lineales y no lineales utilizando circuitos moleculares que operan como redes neuronales, enfocandonos en el mecanismo de secuestramiento molecular.

Clasificadores Lineales

Una función de activación es una función matemática que describe si una neurona se activará o no, según la intensidad de la señal que recibe. Podemos imaginarlo como un interruptor de luz que se enciende solo si la señal supera cierta intensidad mínima. A esta intensidad mínima se le denomina valor umbral: si la señal es menor, no habrá respuesta; pero si es mayor, la neurona responderá. Una de las funciones más utilizadas es la Rectified Linear Unit, o ReLU, descrita por la siguiente ecuación:

En este contexto, para implementar las redes neuronales biomoleculares, necesitaremos un circuito biológico tal que la relación entre sus entradas y salidas exhiba también una forma de definir un valor umbral. Es decir, que su mapa de entradas y salidas exhiba thresholding. Hemos ya estudiado un mecanismo que nos permite obtener este tipo de comportamiento: el secuestramiento molecular.

Consideremos una ligera variante del sistema que estudiamos en la Lecture Note #1. Sean $Y$ y $Z$ dos genes que producen proteinas del mismo nombre en respuesta a ciertas entradas $X_1$ y $X_2$ que controlan dicha producción (e.g., moléculas pequeñas en un promotor inducible). Las proteinas $Y$ y $Z$ pueden interactuar entre ellas por secuestramiento molecular. Podemos describir este sistema con las siguientes reacciones químicas:

Utilizando la ley de acción de masas, podemos modelar dichas reacciones químicas con las siguientes ecuaciones diferenciales:

Recordemos las ecuaciones de conservación de masa ($y^T = y + c$ y $z^T = z + c$), de modo que en estado estacionario, obtuvimos la siguiente expresión para $\bar y$,

Si ahora consideramos un régimen donde el secuestramiento es muy rápido, en el límite obtendremos

Podemos reescribir esta ecuación como

A la izquierda de la Figura 1, observamos el valor de $\bar y$ para un valor muy pequeño de $K$ y diferentes valores de $x_1$ y $x_2$. Esta respuesta se asemeja a un clasificador lineal, donde la línea recta que divide entre una salida nula y una diferente a zero se denomina frontera de decisión. A la derecha de la Figura 1, observamos que la transición se da en $x_1 w_1 = x_2 w_2$, el cual define el valor umbral. Por este comportamiento, y dada la ecuación anterior, confirmamos que la reacción de secuestramiento se comporta como una neurona! Por notación, si nos referimos a una única neurona, esta recibirá el nombre de perceptron.

Como vimos en nuestra ecuación anterior, este comportamiento se da cuando la tasa de secuestramiento es muy alta (o, equivalentemente, cuando la constante de disociación es muy baja). Nos debemos preguntar entonces, ¿qué ocurre con nuestro clasificador si relajamos esta condición?

¿Cómo ajustar la frontera de decisión?

Bajo el mismo argumento utilizando anteriormente, podemos generalizar la respuesta de nuestra reacción de secuestramiento molecular de la siguiente forma,

En otras palabras, la salida estará dada por la resta entre el producto de las entradas $X_i$ que producen la especies $Y$ a una tasa $w_i$, y las entradas $X_j$ que producen la especie $Z$ a una tasa $w_j$. Es importante reconocer que ni las concentraciones ni las tasas de producción son negativas. El signo negativo asociado a ciertas entradas se da por la dinámica de la reacción de secuestramiento. Siguiendo esta lógica, si invertimos el orden de las entradas y evaluamos la salida $\bar y$, obtendremos también una decisión invertida.

Si evaluamos nuevamente la ecuación para $\bar y$, nos daremos cuenta de una estrategia para cambiar la frontera de decisión: ajustar los pesos $w_i$ y $w_j$. Experimentalmente, como estos están dados por las tasas de producción de cada especie, ajustar los pesos implicaría cambiar la tasa de transcripción y/o traslación (Nakamura et al, 2025). Simulemos este caso cambiando los valores de $w_1$ y $w_2$.

Finalmente, introduzcamos un nuevo concepto en nuestro análisis: la región de clasificación , representada por la gradiente de colores en nuestros gráficos y determinada por la frontera de decisión. Así como podemos modificar la ''rotación'' de esa frontera, también podemos desplazar la región de clasificación añadiendo una especie química adicional de concentración constante, conocida como bias.

Clasificadores no lineales

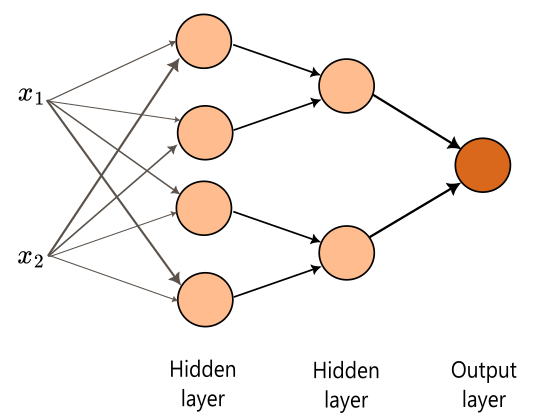

Un perceptrón multicapa extiende los clasificadores lineales al incorporar capas ocultas, lo que permite generar fronteras de decisión no lineales. En esta arquitectura, como se muestra en la Figura cada nodo calcula una salida a partir de sus entradas, y esas salidas alimentan a la siguiente capa.

Para diseñar este tipo de clasificadores, debemos conectar la salida de un perceptron hacia la siguiente capa.

Lecturas recomendadas

[1] Samaniego, C.C. et al. (2021) ‘Signaling-based neural networks for cellular computation’, 2021 American Control Conference (ACC), pp. 1883–1890. doi:10.23919/acc50511.2021.9482800.

[2] Samaniego, C.C. et al. (2024) ‘Neural networks built from enzymatic reactions can operate as linear and nonlinear classifiers’, 2024 IEEE 63rd Conference on Decision and Control (CDC), pp. 6292–6297. doi:10.1109/cdc56724.2024.10886454.

[3] Chen, Z. et al. (2024) ‘A synthetic protein-level neural network in mammalian cells’, Science, 386(6727), pp. 1243–1250. doi:10.1126/science.add8468.

[4] Nakamura, E. et al. (2025) Sequestration-based neural networks that operate out of equilibrium [Preprint]. doi:10.1101/2025.05.16.654484.